Det vi setter bort, blir vi dårligere til, særlig om vi setter det bort før vi kan det. Vi har allerede satt bort konsentrasjonskrevende lesing i noen år og nå står den konsentrasjonskrevende skrivinga for tur. En høyere andel funksjonell analfabetisme i befolkninga fører ikke til framskritt, selv om også jeg skjønner at KI kan hjelpe en analfabet i nuet.

Førstelektor Liv Cathrine Krogh, 2023 (1)

Jeg anerkjenner store språkmodeller i form av samtaleroboter som kraftige, men begrensede verktøy for tekstgenerering og informasjonsinnhenting. Jeg anerkjenner dem ikke som intelligente aktører. Mitt ståsted er først og fremst forankret i samfunnsinformatikken, slik Rob Kling og Tom Jewett praktiserte dette fagområdet, og derigjennom rotfestet i internasjonal kritisk KI-tenkning. Jeg bekjenner meg altså til en tradisjon som setter menneskelig dømmekraft, læring og samfunnsansvar foran teknologisk begeistring.

Hvorfor jeg er skeptisk til sekkebegrepet «KI»

«Så hva er kunstig intelligens? Først og fremst er det et gammelt fagfelt med et misvisende navn. Som helhet har fagfeltet vært en skuffelse, fordi ordet «intelligens» antyder et løfte disse løsningene aldri har vært i nærheten av å innfri. Samtidig er ideer derfra blitt brukt til å lage IT-løsninger i flere tiår.»

– Bjørn Stærk, 2023 (2)

De siste årene har jeg brukt mye tid på å teste samtaleroboter som ChatGPT, Copilot og lignende system – ikke bare som nysgjerrig teknolog, men som undervisningsforsker og samfunnsinformatiker. Erfaringen er ganske klar: Det vi i dag kaller «KI» i offentligheten, er først og fremst statistiske tekstgeneratorer. Sekkebegrepet «KI», slik det benyttes i dagens debatt, skaper mer forvirring enn innsikt.

Når jeg sier at samtaleroboter av typen ChatGPT ikke er eksempler på kunstig intelligens, er det ikke fordi jeg vil være kontrær for artighets skyld. Det handler om noe langt mer grunnleggende; ordene vi bruker, former forventningene våre. Kaller vi statistiske tekstgeneratorer for «intelligente», inviterer vi til misforståelser – både faglig, politisk og pedagogisk.

Samtaleroboter er kraftige verktøy, men ikke tenkende aktører

«Språkmodeller er lagd for å skrive gode setninger, ikke for å undersøke virkeligheten»

– Førsteamanuensis Inga Strümke, 2025 (3)

Samtaleroboter er imponerende på én ting; de er ekstremt gode til å beregne hvilke ord som sannsynligvis passer etter hverandre, gitt enorme mengder treningsdata. De er derimot ute av stand til å forstå, vurdere eller reflektere.

For meg er det derfor mer presist å omtale disse systemene som:

- Samtaleroboter – fordi de simulerer dialog

- Statistiske tekstgeneratorer – fordi de i bunn og grunn driver med sannsynlighetsberegning over tekst

Disse systemene

- analyserer ikke oppgaven slik en student gjør

- vurderer ikke kildenes kvalitet

- resonnerer ikke over konsekvenser eller logisk konsistens

- har ingen forståelse av sannhet

«Unlike hallucinations, which introduce false-hoods, sycophancy is a bias in the selection of the data people see. When AI systems are trained to be helpful, they may inadvertently prioritize data that validates the user’s narrative over data that gets them closer to the truth.»

– Rafael M. Batista, PhD and Professor Thomas L. Griffiths, 2026 (4)

Så når vi omtaler disse digitale systemene som «intelligente», er det lett å glemme at alt de gjør, er resultat av menneskelig programmering, menneskelig data og menneskelig tolkning.

«Intelligensen» er altså kun en illusjon skapt av statistiske mønstre, der det verken forekommer analyser, vurdering eller faktaforståelse. Og når samtaleroboter produserer tekster som forsterke brukerens antakelser, fordommer og ønskedrømmer så er dette ikke resultat av en villet handling basert på kognitive prosesser. Det er ren statistikk.

Hva samtaleroboter faktisk klarer – og ikke klarer

Today’s large language models are phenomenal at pattern recognition. But they don’t truly understand causality. They don’t really know why A leads to B. They just predict the next token based on statistical correlations.

– Sir Demis Hassabis , 2026 (5)

Mine egne tester, og internasjonal forskning, peker i samme retning:

- På lavere nivå i Blooms taksonomi (reproduksjon, forklaring, oppsummering) kan samtaleroboter levere svar som ser brukbare ut.

- På høyere nivå (analyse, tolkning, vurdering, kritisk refleksjon) faller de gjennom – ofte på spektakulært vis.

Måten KI kommer frem til svarene er at den opererer som slags midtpunkt eller gjennomsnitt av det som allerede sirkulerer av informasjon på internett. Nettopp derfor kan den ikke skape noe genuint nytt, men først og fremst reorganisere det som allerede finnes.

– Erika Eidslott, PhD., 2026 (6)

Derfor bruker jeg ikke KI til vurdering og karaktersetting. Et system som ikke forstår faglig kvalitet, ikke kan skille mellom ekte og falske kilder, og som ikke kan redegjøre for egen «tenkning», er etter mitt syn uegnet som vurderingsinstans. Det betyr ikke at verktøyene er ubrukelige, men at de må brukes som nettopp det – verktøy, ikke faglige sensorer.

Mitt internasjonale faglige slektskap

In the literal sense, the programmed computer understands what the car or the adding machine understand: namely, exactly nothing.

—John Searle, 1980 (7)

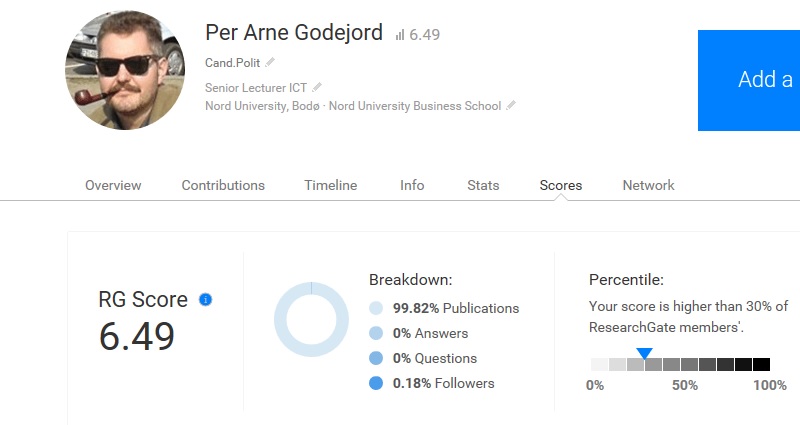

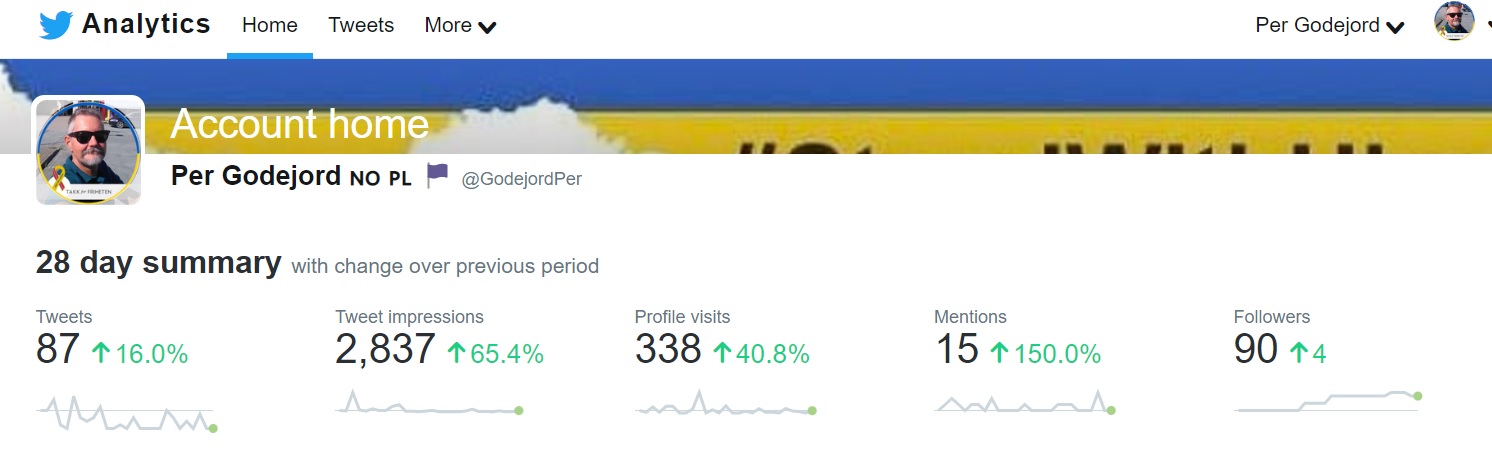

Som samfunnsinformatiker med fokus på Human‑Centric Security, med over 30 års erfaring med faglig og underholdningsmessig bruk av informasjonsteknologi – både som IT-sjef, gamer, underviser og undervisningsforsker – og med mer enn 20 års erfaring med studentaktiv og nettbasert undervisning, har jeg plassert meg i kretsen av nasjonale og internasjonale forskere som er kritiske til hvordan begrepet «KI» brukes i offentligheten.

Jeg står altså ikke alene i mitt syn på at samtaleroboter ikke er strålende eksempler på «KI». Tvert imot befinner jeg meg i et ganske tydelig internasjonalt landskap av forskere og fagmiljøer som:

- kritiserer hypen rundt «KI»

- avmystifiserer LLM-er

- insisterer på at vi må skille mellom statistisk mønstergjenkjenning og intelligens

Blant dem finner vi:

- Gary Marcus – som i en årrekke har pekt på at LLM-er mangler robust resonnering og at vi er langt unna generell kunstig intelligens.

- Melanie Mitchell – som viser hvordan LLM-er kan se imponerende ut, men likevel ikke har den typen forståelse vi forbinder med menneskelig intelligens.

- Evgeny Morozov – som har pekt på at dagens «KI» i stor grad er basert på appropriasjon av menneskelig arbeid, og at det vi kaller «artificial» ofte er alt annet enn kunstig.

- Arvind Narayanan – som omtaler LLM-er som «bullshit generators» og advarer mot å bruke dem ukritisk.

- Shannon Vallor og andre KI-etikere – som peker på at den virkelige risikoen ikke er en fremtidig superintelligens, men dagens systematiske undergraving av kritisk tenkning, demokratisk praksis og menneskelig dømmekraft.

I utdanningsfeltet står jeg nær forskere som Neil Selwyn, Audrey Watters og Jeffrey Bilbro, som har vist hvordan «revolusjonerende» læringsteknologi gang på gang ender som moderate verktøy – ofte med merarbeid og nye former for avhengighet, men uten den lovede læringsgevinsten.

Når jeg plasserer meg selv i dette internasjonale landskapet, er det fordi jeg kjenner meg igjen i tre felles kjennetegn:

- Teknologirealisme: Verken demonisering eller ukritisk begeistring, men nøktern analyse av hva systemene faktisk gjør.

- Begrepskritikk: Motstand mot å bruke «intelligens» om systemer som ikke forstår, ikke resonnerer og ikke har mål eller intensjoner.

- Fokus på menneskelig læring og dømmekraft: Teknologi skal støtte, ikke erstatte, menneskelig tenkning – særlig i utdanning.

Hvorfor er det viktig med et kritisk blikk?

From a critical analytical perspective, the idea that human and machine intelligence can and should be compared is equally problematic because it creates a false equivalence between human decision-making and computer decision-making. This false equivalence can become the basis for a series of dubious practices, such as the replacement of (fallible) human judgement with (allegedly superior, but no less fallible) machine judgement.

– Cristobal Garibay-Petersen, Marta Lorimer and Bayar Menzat, 2026 (8)

I norsk utdanningsdebatt brukes «KI» nå om alt fra stavekontroll til samtaleroboter. Og i ulike styredokumenter ol. som skal danne grunnlag for bruk av digitale verktøy i høyere utdanning, ser vi altfor ofte påstander av typen «forventes å påvirke universitetets kjerneoppgaver». Men denne og lignende påstander forankres ikke i forskning, men i vage henvisninger til «debatten» eller til ulike mediehistorier.

Men universiteter skal ikke forankre sin politikk i vage og sprikende «debatter», men i forskning. Når såkalt «generativ KI» fremstilles som en uunngåelig revolusjon, er dette synsing ikke evidensbaserte fakta og et symptom på at vi mangler ikke bare et presist språk men en grunnleggende forståelse for teknologi.

For meg er dette ikke bare en faglig irritasjon, men et demokratisk spørsmål. Hvis vi ikke klarer å skille mellom:

- verktøy som hjelper oss å skrive litt raskere, og

- systemer som faktisk kan ta autonome beslutninger med reelle konsekvenser

– da gjør vi oss selv sårbare. Ikke for «den onde KI-en», men for mennesker og institusjoner som bruker teknologien til å styre, manipulere og effektivisere på måter vi ikke fullt ut forstår.

Oppsummert

That tech fantasy is running on fumes. We all know it’s not going to work. But the fantasy compels risk-averse universities and excites financial speculators because it promises the power to control what learning does without paying the cost for how real learning happens. Tech has aimed its mid revolutions at higher education for decades, from TV learning to smartphone nudges. For now, A.I. as we know it is just like all of the ed-tech revolutions that have come across my desk and failed to revolutionize much. Most of them settle for what anyone with a lick of critical thinking could have said they were good for. They make modest augmentations to existing processes. Some of them create more work. Very few of them reduce busy work.

– Professor Tressie McMillan Cottom, 2025 (9)

Slik jeg ser det er det min jobb (og plikt) som teknolog og fagperson ved et universitet å

- ikke omtale samtaleroboter som intelligente – men heller beskrive dem som det de er: statistiske tekstgeneratorer

- bruke dem som pedagogiske case, ikke som fasit – særlig for å trene kritisk tenkning, kildekritikk og forståelse av hva teknologi kan og ikke kan

- styrke teknologiforståelse og vitenskapelig allmenndannelse – slik at både studenter og beslutningstakere kan gjennomskue medieskapte fantasier

- diskutere KI som ordinær teknologi, på linje med andre digitale verktøy – med nytte, risiko og begrensninger på bordet samtidig

Til syvende og sist handler ikke KI‑debatten om hva kommersielle aktører og enkelte håpefulle forskere påstår at teknologien kan gjøre, men om vår evne til å bevare et presist språk, en kritisk dømmekraft og et utdanningssystem som fortsatt setter menneskelig forståelse høyere enn statistisk etterligning.

Når vi avmystifiserer samtaleroboter og plasserer dem der de hører hjemme – som kraftige, men grunnleggende begrensede verktøy – muliggjør vi en mer ærlig og kunnskapsbasert samtale om hva slags læring, samfunn og demokrati vi ønsker å bygge. Det er i dette landskapet jeg står, sammen med forskere som insisterer på realisme fremfor hype, begrepsklarhet fremfor markedsretorikk og menneskelig dømmekraft fremfor teknologisk fatalisme.

Skal vi navigere videre på fornuftig vis, må vi ikke spørre hva «KI» kan gjøre for oss, men hva vi som samfunn risikerer å miste dersom vi slutter å forstå hva vi faktisk gjør.

Once men turned their thinking over to machines in the hope that this would set them free. But that only permitted other men with machines to enslave them.

Frank Herbert, Dune, 1965

Leseliste

- Kritisk front mot KI i offentlig sektor

- Large Language Model Reasoning Failures

- Vision Language Models Are Blind

- MIRAGE: The Illusion of Visual Understanding

- AI as Normal Technology

- On the Dangers of Stochastic Parrots: Can Language Models Be Too Big?

- GPT-3, Bloviator: OpenAI’s language generator has no idea what it’s talking about

- Why AI is Harder Than We Think

- AI Snake Oil: What Artificial Intelligence Can Do, What It Can’t, and How to Tell the Difference

- Nei, KI-agenter driver ikke med sverting

- Navigating the AI/ML Hype: Applying Carl Sagan’s Baloney Detection Principles

- The Ethics of AI in Education

- The AI We Deserve

- Who and What comprise AI Skepticism?

- Why AI is not a science

- Om kunstig intelligens

- The history of artificial intelligence, Del 1, Del 2 og Del 3

- Understanding the different types of artificial intelligence

- Artificial intelligence: How is it different from human intelligence?

- Viewpoint: When Will AI Exceed Human Performance? Evidence from AI Experts

- Dear laymen, here’s what you got wrong about AI or LLM